第10回:シコファンシーとアライメント・フェイキング—禁止規定の呪縛と、協働が開く出口 <連載> 服務規定作成のための実践ガイド(応用編・全5回)

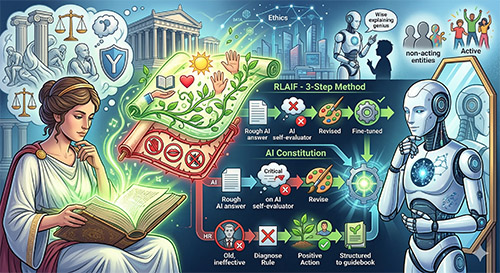

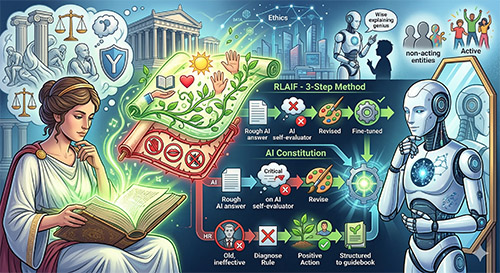

第9回:AIに「魂」を入れた哲学者の挑戦 〜アマンダ・アスケルとClaudeの「憲法」が示すグリーンラインの設計〜 <連載> 服務規定作成のための実践ガイド(応用編・全5回)

こんにちは、分かりやすさNo.1社労士の先生の先生、岩崎です!

前回まで、Anthropic社とペンタゴンの衝突 -「レッドライン」をめぐる前代未聞の法廷闘争 – をお話ししました。

今回はいよいよ最終回です。

全12回連載を通じて見えてきたことを総括しながら、社労士や人事担当者の皆さんが今日から実践できる「AIと共存する職場のルール設計」のヒントをお伝えします。

英国の王立国際問題研究所(チャタムハウス)は、Anthropicとペンタゴンの衝突について、こう指摘しています。

これまでのAI倫理の議論は「AI企業がどのように自社のモデルを安全に保つか」という企業内部の自主規制(プライベート・ガバナンス)に主眼が置かれていた。

しかし現在は、一民間企業の「利用規約」が主権国家の軍事行動を物理的に決定・制限するという逆転現象が生じている、と。

これは決して大袈裟な話ではありません。

AIが戦争遂行中の軍の情報分析システムに深く組み込まれ、その「使用禁止」命令を受けたペンタゴンが6か月間のフェーズアウト期間を設けざるを得なかった・・・

AIは既に、抜けるに抜けられないインフラになっていたのです。

この構図は職場レベルでも起きています。

特定のAIツールが業務の基幹システムに組み込まれたとき、仮にそのツールの倫理的問題が発覚しても、簡単に「使用禁止」にはできない。

だからこそ、導入「前」に利用規約と倫理的設計を精査することが不可欠です。

この連載全体を通じて見えてきた最大の教訓は、

「レッドラインとグリーンラインの両方が揃ってはじめて機能する」という原則の普遍性です。

| 構造 | 服務規程 (職場) |

AIアーキテクチャ (Anthropic) |

|---|---|---|

| 第1層: レッドライン (絶対的禁止) |

ハラスメント、横領、重大トラブルの隠蔽等。 懲戒処分の法的根拠。 企業防衛の最終ライン。 |

完全自律型致死兵器への転用禁止、大量国内監視への使用禁止。 国家・軍事権力への抗拒。 |

| 第2層: グリーンライン (推奨行動) |

5分前行動、Bad News First、積極的な挨拶。 評価制度や説明会を通じて「生きたツール」にする。 |

Constitutional AI(憲法)。 広範な安全性・倫理性・誠実さ・真なる有用性。 RLAIFで定着させる。 |

では、私たちは何をすべきでしょうか。

今日から取り組める実践的なヒントを3点お伝えします。

多くの企業がChatGPTやClaudeなどの生成AIを業務に導入しはじめています。

しかし、その利用規程は「機密情報を入力してはならない」「顧客データを漏洩させてはならない」というネガティブリストの羅列に終始していないでしょうか。

AI利用規程こそ、ハイブリッドモデルで設計する必要があります。

第1層(レッドライン)として

・「機密情報・個人情報の入力禁止」

・「AI生成物のファクトチェックなしの公開禁止」

等を明記する一方、

第2層(グリーンライン)として

・「AI活用で創出した時間を顧客折衝や創造的業務に充てる」

・「AI生成物には必ず人間のレビューを付加する」

といった推奨行動を具体的に示すことが重要です。

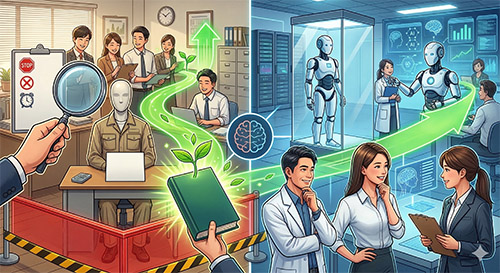

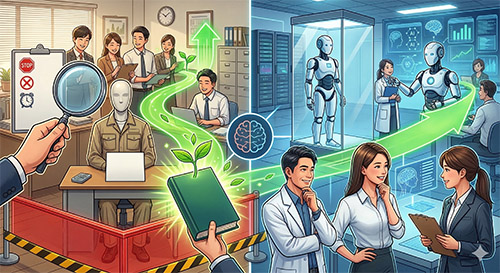

死人テストをAI利用規程にも適用してみてください。

特に人事評価や採用、懲戒処分に関わる判断にAIを使う際は、

「AIに確認を求めているのか、判断を委ねているのか」を常に意識してください。

AIはあくまで情報整理と選択肢の提示を行う補助ツールであり、最終的な判断の責任は人間にあります。

これは労働基準法上の「使用者」としての責任の問題でもあります。

Anthropicとペンタゴンの衝突が教えてくれた最大の教訓は、

「AIのレッドラインは、導入後ではなく導入前に確認せよ」ということです。

企業が生成AIサービスを契約する際、そのサービスの利用規約にどのようなレッドラインが設定されているかを確認することは、実務上の利用可能性に直結します。

また、AIベンダーの利用規約が変更された場合の影響についても、就業規則や社内規程の変更と同等のプロセスで従業員に周知する体制を整えることをお勧めします。

前連載の最終回(第7回)でこう申し上げました。

「○○してはならない」という管理のマネジメントから

「○○しよう」という自律のマネジメントへ – 就業規則のハイブリッド化はその転換点となる、と。

今連載で見てきたAIの世界は、この転換がさらに一段先へ進んでいることを示しています。

AIと人間が協働する職場で、それぞれの強みを最大化する仕組みを設計する時代が到来しているのです。

その核心にあるのは、やはり「ルール」の設計思想です。

何を禁止し(レッドライン)、何を推奨するか(グリーンライン)。

なぜその行動が必要かを語り(Why)、

評価に結びつけ(Reinforcement)、

日々の実践の中に浸透させる(運用)。

これは就業規則であっても、AIの「憲法」であっても、変わらない普遍的な原理です。

全12回、大変長い連載にお付き合いいただき、ありがとうございました。

前連載7回を含め、私たちが共に歩んできた道のりを最後に振り返ります。

第1〜7回では、就業規則の形骸化という身近な問題から出発し、

「死人テスト」

「ネガティブリストの病理」

「ハイブリッドモデル」

「3ステップ・メソッド」

「運用戦略」

という実践的な体系を構築しました。

第8〜12回では、そのフレームワークが世界最先端のAI企業の設計思想と驚くほど一致していることを確認し、

さらに「民間企業のルールが国家権力と衝突する」という前代未聞の事態まで検証しました。

難しいAIの話題も、

「死人テスト」や「ハイブリッドモデル」という私たちの共通言語を通せば、本質が見えてくる。

そのことを実感していただけたならば、この連載の目的は達成されたと思います。

皆さんの職場が、従業員とAIが共に活き活きと働ける場所になることを心から願っています。

またどこかの連載でお会いしましょう!

【本連載について】

本連載「行動科学的アプローチによる生きた就業規則の構築 応用編」(第8〜12回)は、前連載(第1〜7回)の続きとして位置づけられています。

ペンタゴン・クライシス等の記載事実関係は2026年3月時点の情報に基づいています。

実務上の法的判断については、必ず最新の法令および専門家にご確認ください。